3 Min. Lesezeit

Der EU AI Act: Was Entscheider:innen in KMUs jetzt wissen müssen

roosi Redaktion : 28.07.25 14:23

Die Künstliche Intelligenz (KI) verändert unsere Wirtschaft grundlegend – das Potenzial für Innovationen ist enorm. Doch mit wachsender Verbreitung steigen auch die Anforderungen an Sicherheit, Transparenz und Ethik beim KI-Einsatz. Mit dem EU AI Act hat die Europäische Union erstmals einen umfassenden Rechtsrahmen geschaffen, der klare Regeln für die Entwicklung und Nutzung von KI-Systemen definiert. Für kleine und mittlere Unternehmen (KMUs) in Deutschland, Österreich und der Schweiz stellt sich die Frage: Was bedeutet der EU AI Act konkret für mein Unternehmen? Welche Pflichten ergeben sich daraus, und wie lassen sich diese effizient umsetzen?

Ziel und Bedeutung des EU AI Act

Der zentrale Antrieb des Gesetzgebers: KI soll sicher, transparent und verantwortungsvoll genutzt werden. Der EU AI Act verfolgt das Ziel, sowohl Unternehmen als auch Bürger:innen und vor den Risiken von KI zu schützen, ohne dabei die Innovationskraft in Europa zu bremsen. Die Verordnung legt dazu verschiedene Rollen und Verantwortlichkeiten fest, die für Unternehmen in der D-A-CH-Region jetzt besonders relevant werden.

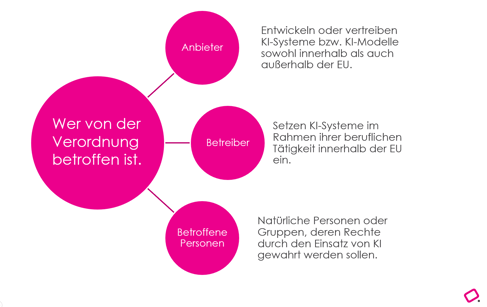

Die wichtigsten Rollen: Anbieter, Betreiber, Betroffene

Die KI-Verordnung unterscheidet zunächst drei Hauptrollen, die Unternehmen und Organisationen einnehmen können:

Anbieter (Provider): Ein Anbieter ist jedes Unternehmen oder jede Organisation, dass ein KI-System oder KI-Modell entwickelt oder entwickeln lässt und dieses auf den Markt bringt – sei es innerhalb oder außerhalb der EU. Der Anbieter muss nicht zwingend in der EU ansässig sein. Er kann ein KI-Produkt kommerziell oder kostenlos bereitstellen. Typische Beispiele sind Entwickler von Chatbots, Analyseplattformen oder Automatisierungs-lösungen.

Betreiber (User): Betreiber nutzen KI-Systeme im beruflichen Kontext innerhalb der EU. In der Praxis sind dies meist Unternehmen, die KI-Lösungen in ihre Geschäftsprozesse integrieren, etwa für die Automatisierung von Bewerbungsprozessen, für Chatbots auf Websites oder für intelligente Entscheidungsunterstützungssysteme. Die Nutzung im privaten Bereich ist vom Gesetz explizit ausgenommen.

Betroffene Personen: Als betroffene Personen gelten natürliche Einzelpersonen oder Gruppen, deren Rechte durch den KI-Einsatz geschützt werden sollen. Das können beispielsweise Mitarbeitende eines Unternehmens sein, aber auch Bewerber oder Kundengruppen.

Wichtig: Die Rollen können wechseln. Beispielsweise kann ein Betreiber, der ein KI-System anpasst und anschließend vermarktet, selbst zum Anbieter werden. Die Wertschöpfungskette ist damit flexibel und erfordert ein regelmäßiges Rollenverständnis und eine Überprüfung der eigenen Verantwortlichkeiten.

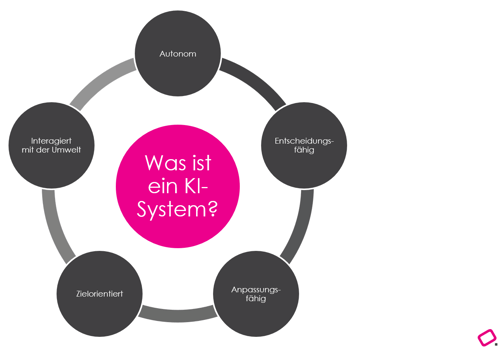

Was gilt als KI-System?

Laut EU AI Act handelt es sich bei einem KI-System um eine Technologie, die autonom agieren und eigenständige Entscheidungen treffen kann. Dies umfasst Systeme, die aus Daten lernen, Vorhersagen treffen oder Aufgaben selbstständig ausführen – etwa Sprachmodelle, Bildanalysen oder Entscheidungsunterstützungstools. Ein wesentliches Merkmal ist die Autonomie: Das System muss eigenständig auf Eingaben reagieren und aus Erfahrungen lernen können. Damit sind auch viele Standard-Softwarelösungen, die maschinelles Lernen oder Datenanalyse einsetzen, potenziell vom Gesetz betroffen.

Ein KI-Modell mit allgemeinem Verwendungszweck (General Purpose AI Model, GPAI) ist besonders breit einsetzbar, ähnlich wie ein Multifunktionstool. Ein prominentes Beispiel ist ChatGPT – es lässt sich in zahlreiche Anwendungen integrieren und übernimmt vielfältige Aufgaben. Für KMUs ist entscheidend, ob ein solches Modell im eigenen Unternehmen verwendet oder sogar an Dritte weitergegeben wird.

Prüfschritte: Verpflichtungen für Anbieter und Betreiber

Um als Unternehmen den gesetzlichen Anforderungen zu entsprechen, empfiehlt sich folgende Vorgehensweise:

Festlegung des Einsatzzwecks: Definieren Sie, wofür Sie die KI einsetzen möchten: Geht es um interne Automatisierungen, Kundenkommunikation, Entscheidungsfindung oder andere Zwecke?

Klare Rollenzuordnung: Bestimmen Sie, ob Ihr Unternehmen als Anbieter, Betreiber oder beides auftritt. Die Einordnung ist relevant für die jeweiligen Pflichten und Nachweiserfordernisse.

Risikoeinstufung vornehmen: Die Verordnung unterscheidet verschiedene Risikoklassen – von minimalem bis zu hohem Risiko. Kritische Anwendungen (z.B. Bewerberauswahl, Kreditvergabe, biometrische Identifikation) werden besonders streng reguliert. Prüfen Sie, welche Einstufung für Ihre Lösung gilt. Hierfür ist insbesondere Artikel 6 des EU AI Acts maßgeblich.

Ableiten von Pflichten: Je nach Risikoklasse und Rolle ergeben sich unterschiedliche Anforderungen. Dazu zählen:

-

Transparenzpflichten: Information über Funktionsweise und Zweck der KI.

-

Dokumentationspflichten: Nachweisführung über Entwicklung, Einsatz und Anpassung des KI-Systems.

-

Risikomanagement: Einführung von Prozessen zur Identifikation, Bewertung und Kontrolle von Risiken.

-

Ethik- und Sicherheitsanforderungen: Gewährleistung, dass die KI-Systeme keine Diskriminierung oder unbeabsichtigte Nachteile verursachen.

Gerade für KMUs empfiehlt sich, bestehende Prozesse (z.B. Datenschutz, IT-Sicherheit) als Ausgangsbasis zu nutzen und um KI-spezifische Aspekte zu erweitern.

Handlungsempfehlungen für KMUs

Bestandsaufnahme: Prüfen Sie, welche KI-Systeme in Ihrem Unternehmen eingesetzt oder entwickelt werden.

Schulungen: Sensibilisieren Sie Mitarbeitende und Führungskräfte für die neuen Anforderungen.

Dokumentation: Führen Sie eine lückenlose Dokumentation Ihrer KI-Projekte und deren Einsatzbereiche.

Rechtsberatung: Ziehen Sie bei Unsicherheiten spezialisierte Rechts- oder IT-Beratung hinzu.

Zukunftssicherheit: Bleiben Sie über Anpassungen des EU AI Acts und weitergehende Regulierung auf dem Laufenden.

Fazit: Der EU AI Act als Chance für KMUs

Der EU AI Act markiert einen Paradigmenwechsel im Umgang mit Künstlicher Intelligenz in Europa. Für KMUs ist die neue Verordnung Herausforderung und Chance zugleich: Wer jetzt Transparenz, Sicherheit und Ethik in den Fokus stellt, gewinnt nicht nur Rechtssicherheit, sondern stärkt auch das Vertrauen von Kunden, Partnern und Mitarbeitenden. Frühzeitige Vorbereitung zahlt sich aus – und eröffnet Potenziale für nachhaltiges, verantwortungsvolles Wachstum im digitalen Zeitalter.